Lamentablemente, el antihéroe creado por Patricia Highsmith en El talentoso Sr. Ripley ya no necesitaría ser talentoso. Los avances en inteligencia artificial generativa, que permiten crear videos realistas, clonar voces y otros tipos de contenidos creíbles, han despojado al arte de su esencia.

Un nuevo estudio realizado por un equipo de la Facultad de Medicina Icahn de Mount Sinai, en Nueva York, ha presentado un alarmante argumento sobre la necesidad de monitorear constantemente la amenaza de las evidencias médicas “deepfake”.

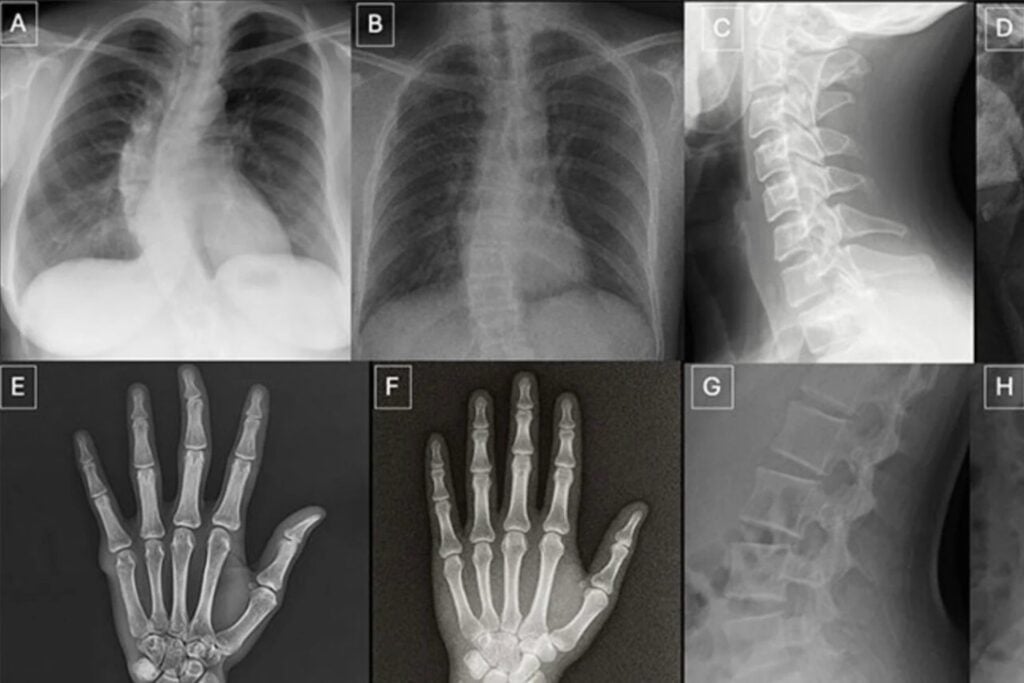

Los investigadores pusieron a prueba a un grupo de 17 radiólogos en actividad de seis países, quienes debían diferenciar entre radiografías auténticas y aquellas generadas por IA, a partir de un conjunto de 264 imágenes. Los resultados fueron preocupantes.

“Nuestro estudio demuestra que las imágenes de rayos X que son deepfakes son lo suficientemente realistas como para confundir a los radiólogos, que son los especialistas más capacitados en imágenes médicas”, afirmó el Dr. Mickael Tordjman, autor principal del estudio y miembro del posdoctorado de la Facultad Icahn. “Esto ocurrió incluso cuando sabían que en el grupo de imágenes había varias generadas por IA”.

En una prueba adicional, las radiografías creadas por IA lograron engañar a uno de los mismos modelos de lenguaje que se usaron para generarlas: ChatGPT-4º de OpenAI.

La amenaza de las falsificaciones

Tordjman inició este proyecto debido a su preocupación genuina por los riesgos que enfrentan los pacientes, los médicos y el público en general. Las imágenes médicas generadas con IA “crean una vulnerabilidad significativa para litigios fraudulentos, como la posibilidad de no poder distinguir entre una fractura real y una falsa”. Este asunto ya ha captado la atención de expertos legales que buscan proteger a los jurados de engaños ante su exposición a falsificaciones similares de IA.

“También existe un riesgo considerable en el ámbito de la ciberseguridad, ya que si hackers logran infiltrarse en una red hospitalaria, podrían insertar imágenes generadas por IA para alterar los diagnósticos de los pacientes, generando un caos clínico”, añadió Tordjman.

Los 17 radiólogos que participaron del estudio observaron dos conjuntos de datos, según lo publicado el martes en Radiology. En la primera fase, se les pidió que analizaran 154 imágenes de rayos X estáticas, donde la mitad eran genuinas y la otra mitad generadas con ChatGPT-4º (77 en cada grupo). En la segunda prueba, se utilizó un modelo de IA especializado en la creación de radiografías creíbles del tórax, denominado RoentGen, que presentaba órganos como el corazón y los pulmones. Los radiólogos debían discernir cuáles eran reales y cuáles eran falsas, con 55 verdaderas y 55 falsas en un total de 100 radiografías.

A algunos radiólogos se les informó que los tres conjuntos contenían imágenes generadas por IA, y estos lograron distinguir mejor que aquellos que no tenían conocimiento previo, aunque sus resultados no fueron óptimos. Su precisión promedio fue del 75% frente al 41% de quienes no estaban informados sobre la presencia de imágenes creadas con IA.

Los radiólogos del estudio tenían experiencia variada (entre 0 y 40 años en actividad) y lograron detectar entre el 58% y el 92% de las imágenes generadas con ChatGPT, y entre el 62% y el 78% en las radiografías de pecho RoentGen. Ni la edad ni la experiencia parecieron influir en la precisión para diferenciar las imágenes, aunque los radiólogos musculoesqueléticos mostraron un mejor desempeño en la detección de imágenes falsas en comparación con otros subespecialistas.

Una prueba

Tordjman y su equipo también realizaron pruebas con cuatro modelos multimodales: ChatGPT-4º y 5, Gemini 2.5 Pro de Google y Llama 4 Maverick de Meta. Los bots obtuvieron resultados ligeramente inferiores a los de los humanos, con una precisión del 57% al 85% en las imágenes falsas de GPT-4º (particularmente decepcionante para ChatGPT-4º).

En cuanto a las radiografías sintéticas de RoentGen, la precisión de los modelos de lenguaje para identificar las falsas varió más, alcanzando entre el 52% y el 89%.

Tordjman espera que se continúe investigando este tema para desarrollar herramientas de detección y medidas educativas. “Las imágenes médicas falsas suelen parecer demasiado perfectas”, indicó. “Los huesos se ven muy suaves y lisos, las columnas vertebrales son excesivamente rectas y no lucen naturales, los pulmones aparecen exageradamente simétricos, los patrones de los vasos sanguíneos son excesivamente uniformes, y las fracturas se ven inusualmente limpias y consistentes”.

Aquí puedes realizar la prueba, aunque no te sientas mal si no logras diferenciar las imágenes. Alguien que conoce bien el arte del engaño dijo: “La vida es una larga serie de malentendidos”.

Este artículo ha sido traducido de Gizmodo US por Romina Fabbretti. Aquí podrás encontrar la versión original.